Python网络爬虫开发从入门到精通 网络技术开发的利器

Python网络爬虫开发,作为网络技术开发中一项极具实用价值的技能,正随着互联网数据的爆炸式增长而愈发重要。从简单的数据抓取到复杂的自动化采集系统,掌握Python爬虫技术意味着能够高效地从互联网上获取、分析和利用海量信息。本文将从入门基础到进阶精通,系统性地介绍Python网络爬虫的开发路径与核心技术。

一、入门基础:环境搭建与请求发送

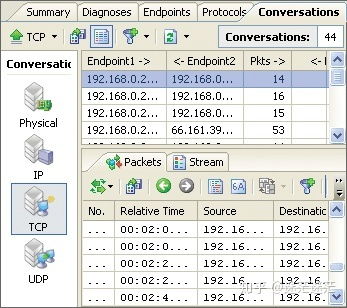

对于初学者而言,首先需要搭建Python开发环境,并安装必要的库,如requests、BeautifulSoup等。理解HTTP/HTTPS协议的基本原理是爬虫开发的基石,包括GET/POST请求、请求头(User-Agent、Cookie等)和状态码。通过requests库发送简单的HTTP请求,获取网页的HTML源代码,是爬虫的第一步。学习使用浏览器开发者工具(如Chrome DevTools)分析网页结构,识别数据所在标签,为后续解析做好准备。

二、数据解析:从HTML到结构化信息

获取原始HTML后,需要从中提取目标数据。BeautifulSoup和lxml是两种常用的解析库,它们支持通过标签名、类名、ID或CSS选择器来定位元素。初学者应熟练掌握BeautifulSoup的find()和find_all()方法,以及如何获取元素的文本、属性。对于动态加载的网页(数据通过JavaScript异步加载),简单的静态解析可能无效,此时需要了解Ajax请求或考虑使用Selenium、Playwright等工具模拟浏览器行为来渲染页面。

三、进阶技巧:应对反爬与效率优化

随着爬虫规模扩大,会遇到网站的反爬虫机制,如IP封锁、验证码、请求频率限制等。进阶开发需掌握以下技术:

1. 请求头模拟与用户代理轮换,伪装成真实浏览器访问。

2. 使用代理IP池,分散请求以避免IP被封。

3. 处理Cookies和Session,维持登录状态。

4. 设置请求延迟(如time.sleep)或使用异步库(如aiohttp)提高效率,同时尊重网站的robots.txt协议。

5. 对于验证码,可尝试OCR识别或使用第三方打码服务。

学习使用Scrapy框架可以大幅提升开发效率,它提供了完整的爬虫工作流管理,包括请求调度、数据管道和中间件支持。

四、精通实践:项目架构与数据管理

精通爬虫开发意味着能构建健壮、可维护的系统。这包括:

- 设计分布式爬虫,利用多线程、多进程或分布式框架(如Scrapy-Redis)实现高速采集。

- 数据存储方案,根据需求选择文件(CSV、JSON)、数据库(MySQL、MongoDB)或云存储。

- 错误处理与日志记录,确保爬虫长期稳定运行,并能从异常中恢复。

- 数据清洗与预处理,使用pandas等库将原始数据转化为可用格式。

- 遵守法律法规与伦理规范,只抓取公开数据,避免侵犯隐私或网站服务条款。

五、网络技术开发的融合应用

Python爬虫不仅是独立工具,更能与其他网络技术结合,赋能更广泛的开发场景。例如:

- 与Web开发结合,自动采集内容更新网站。

- 与数据分析结合,为机器学习模型提供训练数据。

- 与监控系统结合,实时追踪价格、新闻或社交媒体趋势。

通过持续实践,如从简单新闻站点到复杂电商平台的全栈爬虫项目,开发者可以深化对网络协议、并发编程和数据工程的理解,真正从入门走向精通。

Python网络爬虫开发是一条从基础请求到系统架构的成长之路。它要求开发者不仅会写代码,更要懂网络、懂数据、懂伦理。掌握这门技术,你将在网络技术开发领域获得强大的数据获取能力,为创新应用打下坚实基础。

如若转载,请注明出处:http://www.dapu100.com/product/78.html

更新时间:2026-04-11 02:17:05